“La información cerebral es única. Con esta información es posible identificar y revelar estados internos.”.

Si los neurodatos permiten inferir estados mentales con creciente precisión, la privacidad mental y la libertad cognitiva exigen salvaguardas explícitas. El European Data Protection Supervisor (EDPS) y la Agencia Española de Protección de Datos (AEPD) alertan de un cambio de escenario: las neurotecnologías salen del entorno clínico y llegan al consumo masivo. Con ellas, crecen los riesgos de intromisión, discriminación y manipulación.

Neurodatos: qué son y por qué importan

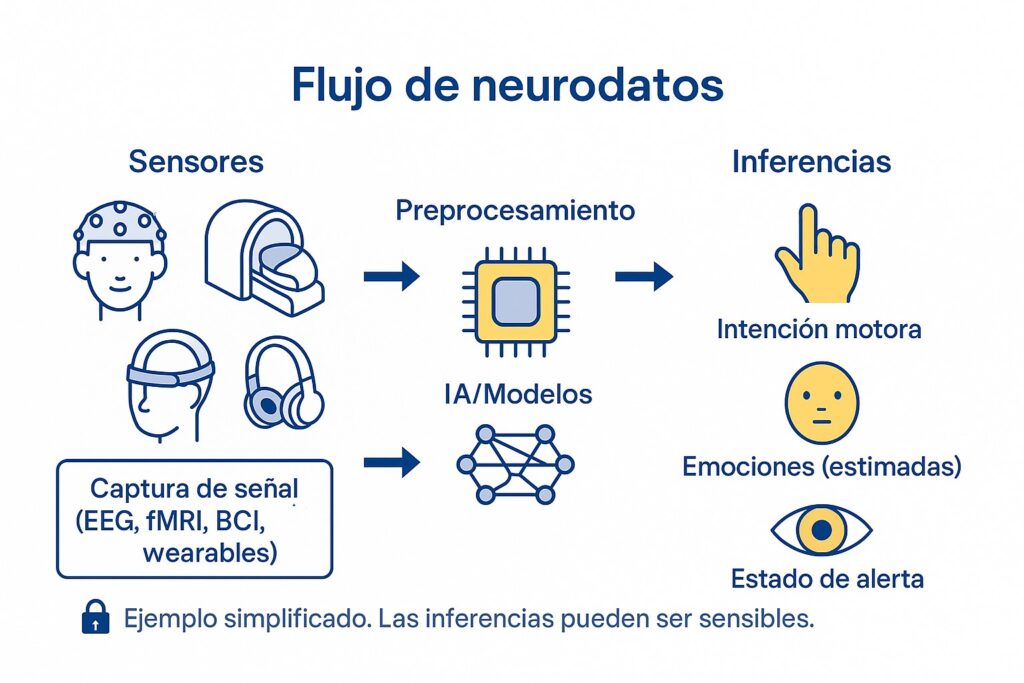

Llamamos neurodatos a señales cerebrales (por ejemplo, EEG o fMRI) y a métricas inferidas con IA (intención motora, estimaciones emocionales). Al combinarse con otras huellas digitales, amplifican lo que puede saberse de una persona.

No es ciencia ficción. Nos rodean auriculares con sensores, diademas de “bienestar” y apps de productividad que ya miden aspectos de nuestra actividad. Los implantes experimentales son solo una parte de la historia.

¿Basta con el RGPD y la nueva ley de IA?

El RGPD (Reglamento General de Protección de Datos) da un punto de partida sólido: cuando los neurodatos revelan salud o pueden identificar a alguien, se tratan como especialmente delicados. En la práctica, esto significa recoger lo mínimo, explicar para qué se usan y realizar una evaluación de impacto antes de desplegar sistemas que capten o infieran señales cerebrales.

La Ley de IA de la UE (AI Act) sube el listón ético: no se puede usar IA para inferir emociones en trabajo o educación, y quedan fuera de juego las técnicas que manipulan a la gente sin que lo note. Es una forma clara de decir: la mente no es un laboratorio opaco.

Cuando los neurodatos se generan en entornos de salud, entra en juego el Espacio Europeo de Datos de Salud (EHDS), que ordena quién puede acceder y con qué fines. Y si hablamos de dispositivos, el Cyber Resilience Act obliga a ciberseguridad por diseño: actualizaciones, gestión de vulnerabilidades y cifrado.

¿Con eso basta? Casi, pero no del todo. Quedan zonas grises: inferencias mentales fuera del ámbito sanitario, posible reidentificación a partir de patrones neuronales y usos de “bienestar” que se cuelan en oficinas o aulas. Ahí es donde necesitamos reglas más explícitas y guías sectoriales que aterricen el “qué se puede” y el “qué no”.

España, hoy: señales de avance

En Cantabria, un anteproyecto de Ley de Salud Digital ya habla de neuroderechos y neurodatos, propone registrar sistemas de IA sanitarios y limita decisiones solo algorítmicas. No está aprobado aún, pero marca una dirección.

En Euskadi, la UPV/EHU dedica una jornada específica a los neuroderechos: academia, juristas y sector público discuten cómo proteger la privacidad mental antes de que la tecnología vaya por delante. Es una buena noticia: el debate ya está en la agenda y no en el laboratorio.

Tres frentes para blindar la privacidad mental

Conviene concentrarnos en tres frentes muy concretos. No hace falta reinventar el sistema: se trata de aplicar bien lo que ya existe y cerrar las grietas más evidentes.

Privacidad mental. El riesgo no es solo “leer” la mente, sino inferir estados sensibles combinando neurodatos con otras huellas digitales. La respuesta es conocida: tratar estos datos como especialmente protegidos cuando corresponda, minimizar su recogida, hacer evaluaciones de impacto antes de desplegar sistemas y, sobre todo, prohibir inferencias no consentidas. Un gesto sencillo ayuda: etiquetas claras en dispositivos y apps que indiquen cuando captan o decodifican actividad cerebral.

Manipulación cognitiva. Las interfaces que adaptan estímulos para empujar decisiones sin que lo notemos cruzan una línea roja. Aquí el AI Act ya marca el terreno: no a las técnicas subliminales o engañosas. ¿Cómo aterrizarlo? Auditorías independientes, pruebas A/B con criterios éticos, ejercicios de red-teaming y un botón de apagado cuando algo se desvíe.

Trabajo y educación. Usar “estimaciones de emoción” o métricas de “atención” para seleccionar personas o vigilar aulas abre la puerta a la discriminación. La pauta es clara: prohibir o limitar estos usos en línea con el AI Act, reforzar a Inspección de Trabajo y a las autoridades educativas, y exigir a empresas y centros que no implanten “emotion AI”.

Un cuarto frente atraviesa a todos: la ciberseguridad. Los neurodispositivos son “productos con elementos digitales” y deben cumplir CRA: gestión de vulnerabilidades, actualizaciones garantizadas, SBOM y cifrado en origen.

¿Normalizaremos la captura y decodificación de actividad cerebral por eficiencia y seguridad, o fijaremos límites duros que protejan autonomía y dignidad? La ventana regulatoria está abierta: consolidar definiciones claras, prohibiciones selectivas y vigilancia independiente es la vía para una neurotecnología útil y confiable.