Víspera electoral. Un vídeo recorre WhatsApp y TikTok a toda velocidad: un candidato pronuncia frases incendiarias. Horas después se confirma lo obvio: era un deepfake. La rectificación llega tarde.

La pregunta es inquietante: ¿cómo sostener la confianza en la democracia cuando ya no podemos fiarnos de lo que vemos y oímos? Los deepfakes son hoy una amenaza directa a la integridad electoral. Los gobiernos no pueden esperar a la próxima crisis: deben regular, vigilar y educar sin caer en la censura.

¿Qué son los deepfakes y por qué preocupan más en 2025?

Son vídeos, audios o imágenes fabricados por inteligencia artificial, capaces de imitar rostros y voces con precisión quirúrgica. En 2018 parecían bromas tecnológicas; en 2025 son armas políticas.

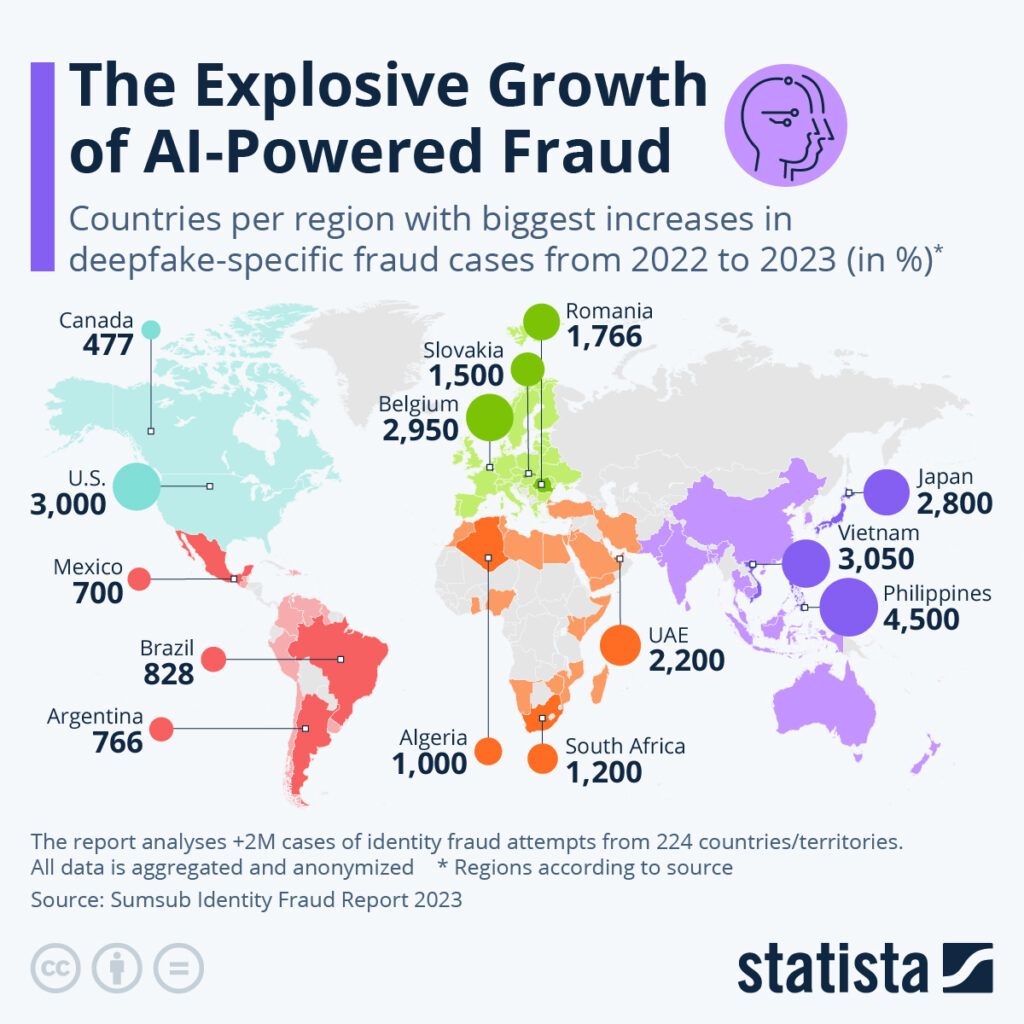

Entre julio de 2023 y julio de 2024 se detectaron 82 deepfakes en 38 países. Además, de ellos 30 de esos países tenían elecciones en curso o previstas.

Evidencia del riesgo: deepfakes y democracia en elecciones recientes

- Eslovaquia (2023): un audio manipulado circuló justo antes de las urnas, con claros signos de haber sido generado por IA. El caso fue tan grave que EE.UU. prohibió el uso de robocalls con IA tras episodios similares en New Hampshire.

- India (2024): vídeos falsificados inundaron redes sociales en estados clave.

- EE.UU. (2024): robocalls imitando la voz de Joe Biden buscaron desalentar la participación.

El Bureau of Investigative Journalism estima que más de 2 000 millones de votantes en 50 países estuvieron expuestos a deepfakes durante 2024.

La amenaza es global: un informe de Associated Press subraya su impacto en comicios de Moldavia, Bangladesh, Taiwán y EE.UU. Aunque el volumen de deepfakes fue menor al anticipado, las plataformas reconocen que reforzaron sus defensas.

El dilema regulatorio

El mapa regulatorio es un mosaico de enfoques:

- Unión Europea: el AI Act, en vigor desde 2024, exige etiquetar contenidos generados por IA. Desde agosto de 2025, las sanciones podrán llegar a 35 millones de euros o el 7 % de la facturación global.

- Dinamarca: innovó al reconocer a los ciudadanos derechos sobre su voz, imagen y apariencia; los deepfakes sin consentimiento podrán retirarse de inmediato, salvo sátira.

- EE.UU.: la Primera Enmienda bloquea avances. La red social X (antes Twitter) demandó a Minnesota por su intento de prohibir deepfakes políticos preelectorales.

La tensión es evidente: demasiada laxitud pone en riesgo la democracia; un exceso de celo puede asfixiar la libertad de expresión.

Herramientas de defensa

La tecnología avanza, pero no al ritmo necesario. Detectores como Hive Moderation o Deepware presentan tasas de error altas.

El MIT, con su proyecto Detect Fakes, explora señales invisibles en rostros y voces para reconocer manipulaciones, pero la carrera es desigual: los generadores de IA mejoran más rápido que los filtros.

La respuesta realista es combinar estrategias:

- Tecnología: marcas de agua obligatorias.

- Instituciones: protocolos de respuesta rápida en juntas electorales.

- Medios: fact-checking colaborativo a escala internacional.

- Ciudadanía: educación crítica. Un estudio de la Oxford University Press confirma que el pensamiento analítico mejora la detección de deepfakes.

Propuestas para elecciones seguras

Cinco medidas que los policy-makers pueden aplicar hoy:

- Trazabilidad obligatoria en todo material audiovisual de campaña.

- Retirada rápida: 24 horas como máximo para que las plataformas actúen.

- Auditorías previas de mensajes masivos de partidos.

- Capacitación electoral en detección de desinformación.

- Observatorio internacional de deepfakes bajo la OCDE o la UE.

El riesgo de sobrerregular

No todos los deepfakes son dañinos. La sátira política y los memes cumplen una función legítima. Dinamarca lo reconoció en su reforma de 2025.

El desafío es claro: atacar la manipulación maliciosa sin matar la creatividad digital.